Sora如何降维打击其他文生视频大模型?记者实测对比

OpenAI的文生视频大模型Sora已经发布两天,其冲击力依然不减。

2月18日,新京报贝壳财经记者进行了Sora与其他文生视频大模型的对比测试,发现Sora在时间和视频生成质量上均对“同行”产生了“降维打击”:其他文生视频大模型仅能生成3至4秒的视频,而Sora生成的视频时间最多可达1分钟,且景物也更加清晰稳定、符合描述。

不过,随着越来越多使用Sora制作的视频出现以及部分技术细节的公开,业界开始对其进行全方位审视,其中,赞扬和惊叹声不少,但Sora生成的视频也被发现存在诸多不合理之处。

文生视频对比实测:Sora从“动图”升级到“短片”

“一个时髦的女人走在东京的街道上,街道上充满了温暖发光的霓虹灯和生动的城市标志。她穿着一件黑色的皮夹克,一件红色的长裙,一双黑色的靴子,还带着一个黑色的钱包。她戴着太阳镜,涂着红色的口红。她自信而随意地走着。街道是潮湿和反光的,创造了一个五颜六色的灯的镜面效果。许多行人走来走去。”这是OpenAI官网介绍Sora时,出现的第一组提示词。

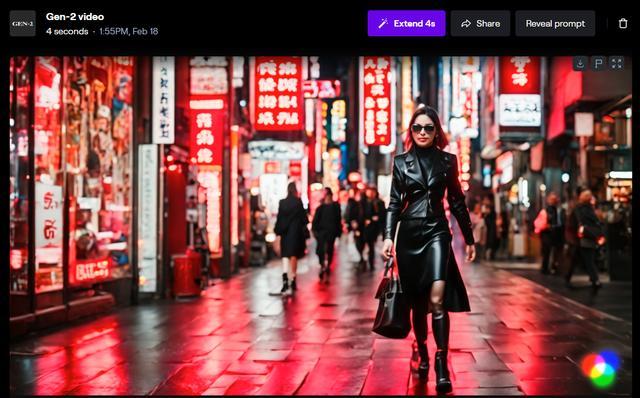

在OpenAI推出Sora之前,文生视频领域的创业公司主要包括Pika、Runway等,为了验证Sora的能力,新京报贝壳财经记者将上述同样的提示词输入Pika文生视频模型,以及Runway旗下的Gen-2video文生视频模型进行了实测。

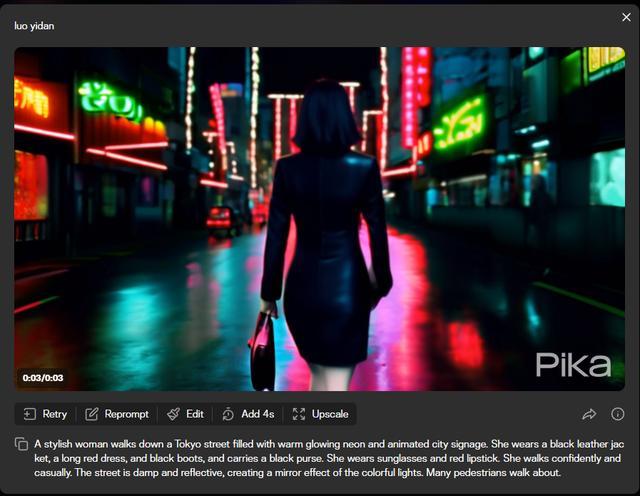

OpenAI官网上Sora生成的视频。

贝壳财经记者发现,在相同的提示词下,Pika仅能生成3秒的视频,Gen-2video则可以生成4秒的视频。其中,Pika的视频为“时髦女人”的背影,无法体现她“戴着太阳镜,涂着红色的口红”的描述,不过对于提示词中“潮湿反光的街道和五颜六色灯的镜面效果”体现得较好,但整体上视频较为模糊。

Gen-2video则跳出了“无法输入这么多提示词”的弹窗,并根据能够输入的部分生成了一个4秒的视频,该视频相比Pika显然精细很多,也符合提示词描述的人物形象,包括“街道、人群、黑钱包”等。

但可以发现,无论是Pika还是Gen-2video,都忽略了“一件红色的长裙”这个细节,且贝壳财经记者通过观看视频发现,这两段视频仍能看出AI生成的影子,特别是Gen-2video的人物脸部,有细微的形变,这正是AI生成视频的特点之一:难以始终保持同一人物的连贯性。

而Sora不仅体现了提示词中的全部细节,而且还很好地保持了人物的连贯性,使得该视频几乎可以“以假乱真”。当然,如果仔细观察,可以发现该视频中人物的脚步在某几个帧会出现不自然的扭曲,以及该视频中的背景广告牌虽然酷似日文,但由于目前AI还无法直接在视频中“认识”文字,其只能生成似是而非的“日文”,这都是AI生成视频的特点之一。

但即便如此,Sora还是用事实显现出了同其他文生视频大模型的代差。

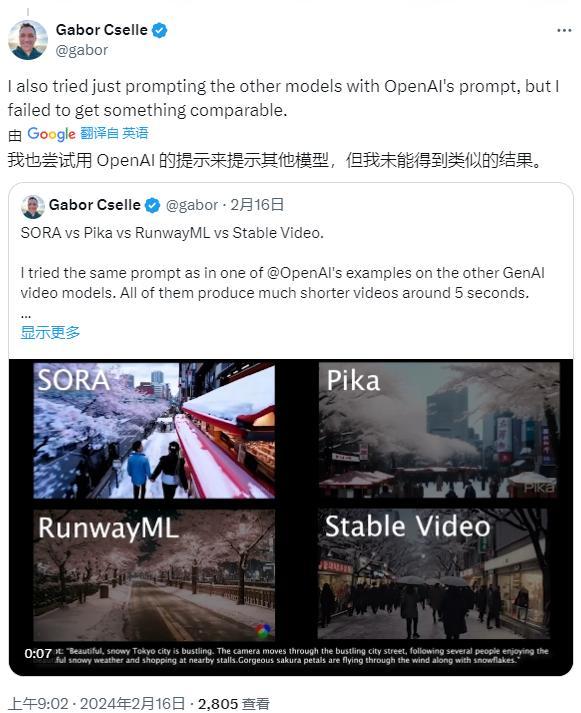

在谷歌和推特都有从业经历的AI创业者Gabor Cselle也发布了使用相同提示词,在其他四个文生视频模型中“复现”Sora“穿过下雪、樱花飞舞的东京街道……”的场景,并表示“其他模型达不到能和Sora比较的效果”。

在国内,也有不少AI从业者直观地感受到了Sora带来的冲击。

清华大学沈阳教授团队一直聚焦AI在各个领域的应用,并也一直在使用AI模型进行文生视频的操作。2月17日,他在朋友圈发布了一条团队成员花两天制作的“半失败”AI视频,并表示“从这里可以看出和Sora的差距,我让她暂时放弃这个作品,等算法升级再重做一下。”

理解物理世界 颠覆影视、游戏行业 Sora是“通用世界模型”吗?

为何Sora能够在视频生成的质量上明显领先同业产品?OpenAI在官方网站上表示,Sora是能够理解和模拟现实世界的模型的基础,相信这一能力将是实现通用人工智能的重要里程碑。不过,Sora还存在很多不完善之处,仍然处于世界模型研究应用的初期阶段。

什么是世界模型?贝壳财经了解到,实际上runway公司在去年12月就提出过要开发通用世界模型(General World Model),用其旗下的Gen-2模型来模拟整个世界,“我们相信,人工智能的下一个重大进步将来自理解视觉世界及其动态的系统,这就是为什么我们要围绕通用世界模型开始一项新的长期研究工作。”

从效果上看,目前OpenAI已经通过Sora部分做到了这一点,因为只有理解物理世界的运行法则,文生视频模型才能创造出更加逼真的视频。英伟达高级科学家Jim Fan就对此表示,Sora是一个数据驱动的物理引擎,“它是对许多世界的模拟,无论是真实的,还是虚构的。该模拟器通过去噪和梯度学习方式,学习了复杂的渲染、直观的物理、长期推理和语义理解。”

而理解现实世界的物理法则,也正是通往通用人工智能这一“终极目标”的必经之路。

对此,不少科技圈名人都发出了惊叹,马斯克直接在社交平台上发布短评“GG世界”(GG是网络游戏的用语之一,原指游戏结束时玩家互相致意,后引申为“游戏结束”)。

360公司董事长周鸿祎则直接在朋友圈发文称,一旦AI能够接上摄像头,观看并理解世界上所有的电影,它对世界的理解能力将远远超过仅仅通过文字学习所能达到的水平。在这种情况下,实现通用人工智能不再是遥不可及的梦想。周鸿祎甚至预测,这一天可能在一两年内就会到来,而不是十年或二十年。

在现实层面,有更多人担心文生视频大模型可能直接冲击影视和游戏行业。美国旧金山早期投资人Zak Kukoff预测,在5年内,一个不到5人的团队将可能用文生视频模型制作出一部票房收入超过5000万美元的电影。

值得注意的是,日前大火的游戏《幻兽帕鲁》的开发团队就仅有4人,有许多人质疑该团队使用了AI生成技术制作游戏角色,以节省成本。而根据OpenAI 发布的最新Sora技术报告,Sora能够模拟视频游戏的数字化过程,Sora能在控制 Minecraft 游戏角色进行基本操作的同时,高质量动态渲染游戏世界。这意味着,个人开发制作游戏的门槛可能会被进一步降低。

前阿里巴巴副总裁,Lepton AI公司创始人贾扬清则直接评价Sora“真的非常牛”,他表示Sora的问世可能会给对作OpenAI的公司带来一波被大厂FOMO(害怕错过机会而导致的收购)收购的机会。贾扬清预测,大模型市场长期仍将呈现闭源寡头的格局,开源大模型仍然需要一段时间才能追赶上,而从算法小厂的角度来看,要么在算法上与OpenAI媲美,要么深耕垂直领域的应用,要么选择开源道路;最后,基础设施的需求将继续猛增。

版权声明

本文收集整理自网络,如有侵权,请联系删除。